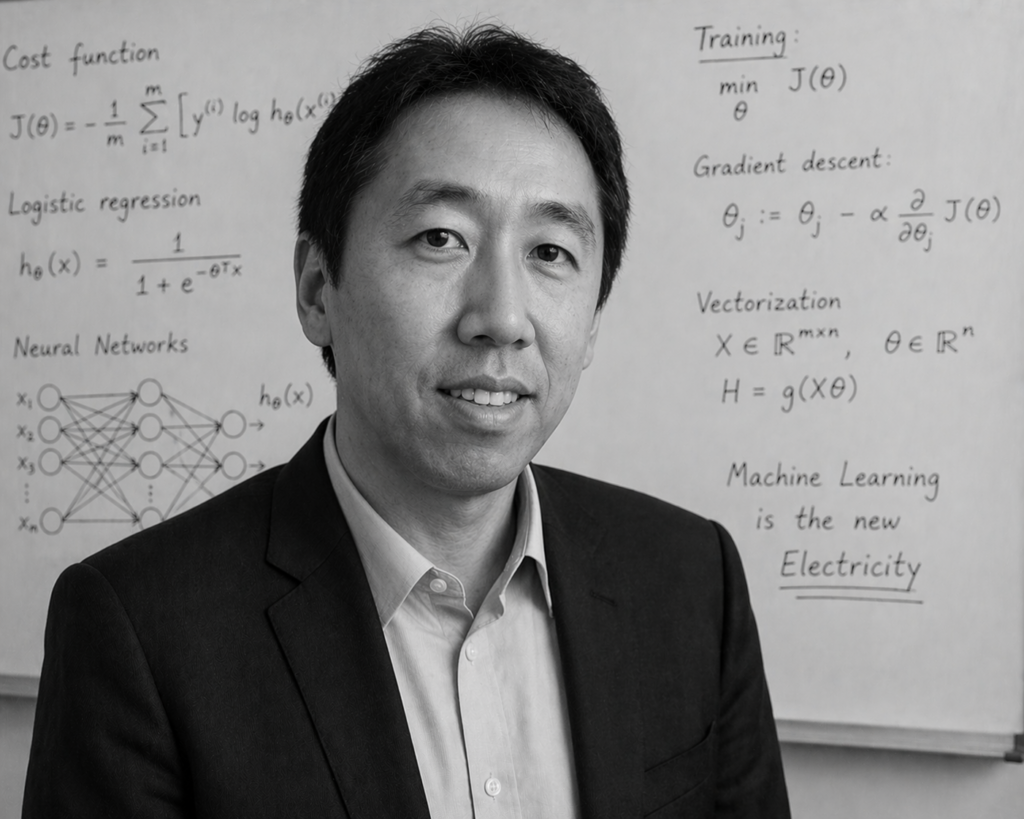

Aujourd’hui, des millions de personnes apprennent l’intelligence artificielle depuis leur canapé, en ligne, gratuitement ou presque. Ce n’est pas un hasard. Derrière cette démocratisation du savoir se cache un homme discret mais immensément influent : Andrew Ng. Chercheur, enseignant, entrepreneur… il a tout fait pour que l’IA ne reste pas l’apanage d’une poignée d’experts.

Né en 1976, Andrew Ng est un informaticien britannico-américain formé à l’Université Carnegie Mellon, puis à l’Université de Californie Berkeley. Très tôt passionné par les mathématiques et les algorithmes, il oriente sa carrière vers le machine learning, une discipline qui consiste à apprendre aux machines à apprendre.

Professeur à Stanford, il acquiert rapidement une réputation d’enseignant d’exception, capable de rendre accessibles des concepts complexes à des milliers d’étudiants.

En 2011, Andrew Ng cofonde Google Brain, le laboratoire de recherche en IA de Google. C’est là que naissent certaines des avancées les plus marquantes en deep learning, notamment des modèles capables de reconnaître des visages ou d’identifier des objets dans des images.

Il rejoint ensuite Baidu, le géant chinois du web, en tant que directeur scientifique, contribuant à l’essor de l’IA en Asie. Ces expériences lui donnent une vision globale des enjeux technologiques, bien au-delà de la Silicon Valley.

En 2012, Andrew Ng cofonde Coursera, la plateforme d’apprentissage en ligne qui compte aujourd’hui plus de 100 millions d’utilisateurs dans le monde. Son cours sur le machine learning, l’un des premiers disponibles gratuitement en ligne, est devenu une référence absolue pour quiconque souhaite entrer dans le domaine.

Cette initiative a littéralement changé la vie de centaines de milliers de personnes, leur permettant de se former à l’IA sans passer par une université d’élite.

Andrew Ng a compris avant beaucoup d’autres que l’IA ne serait vraiment puissante que si elle était accessible au plus grand nombre. En combinant recherche de pointe, applications industrielles et éducation ouverte, il a contribué à façonner un écosystème IA mondial, inclusif et en constante évolution.

Andrew Ng a fait de l’intelligence artificielle non plus un sujet réservé aux laboratoires, mais un outil que chacun peut comprendre, apprendre et utiliser.

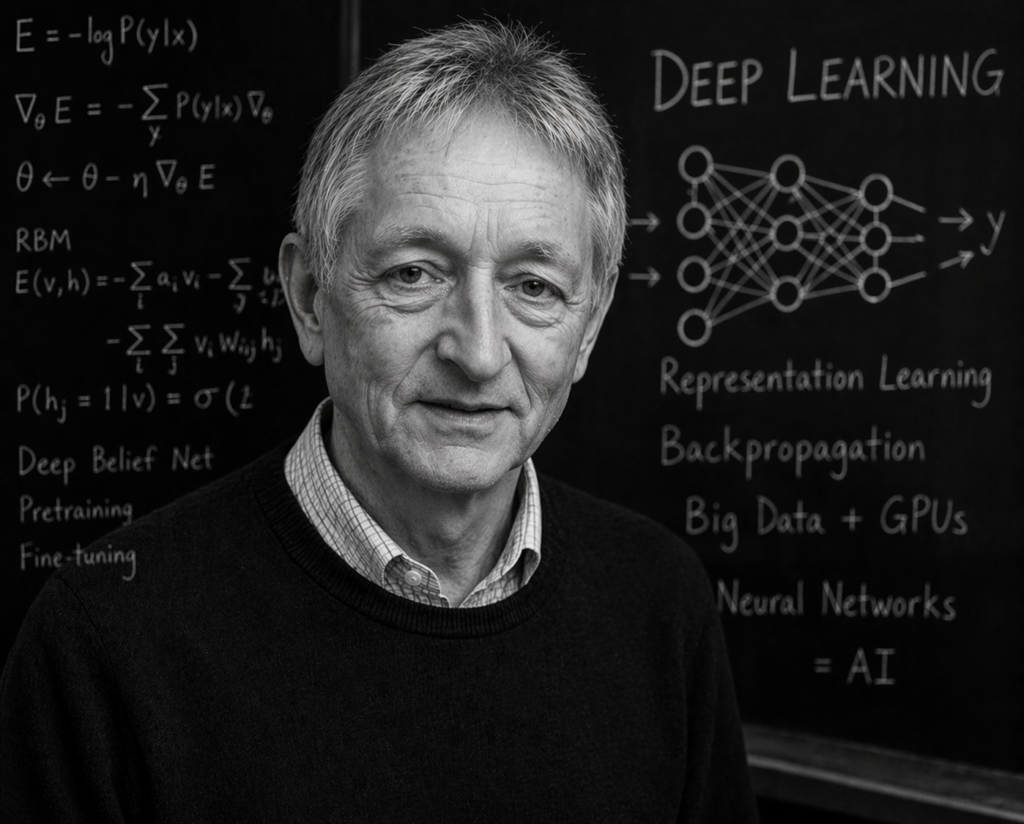

Lorsque l’on parle d’intelligence artificielle, il est impossible de passer à côté des technologies capables de reconnaître des images, comprendre du texte ou encore générer du contenu. Derrière ces avancées se cache en grande partie le travail d’un homme : Geoffrey Hinton. Souvent surnommé le « parrain de l’IA », il est l’un des chercheurs les plus influents de notre époque. Mais quel a été son rôle dans cette révolution technologique ?

Geoffrey Hinton est un chercheur britannique né en 1947, spécialisé en informatique et en neurosciences. Très tôt, il s’intéresse à la manière dont le cerveau humain fonctionne, avec une idée en tête : reproduire ces mécanismes à l’aide de machines.

Professeur dans plusieurs universités de renom, notamment à Toronto, il consacre sa carrière à un domaine longtemps considéré comme marginal : les réseaux de neurones artificiels. Une approche qui, à ses débuts, ne faisait pas l’unanimité dans la communauté scientifique.

Dans les années 1980 et 1990, Geoffrey Hinton travaille sur des modèles capables d’apprendre à partir de données, en s’inspirant du fonctionnement des neurones biologiques. À l’époque, la puissance de calcul est encore limitée, ce qui freine fortement les applications concrètes.

Mais tout change dans les années 2010. Grâce à l’augmentation des capacités informatiques et à l’explosion des données disponibles, ses travaux prennent une nouvelle dimension. Les réseaux de neurones profonds, ou « deep learning », deviennent alors la base des systèmes d’intelligence artificielle modernes.

Reconnaissance vocale, vision par ordinateur, traduction automatique… autant d’innovations directement issues de ses recherches.

Après avoir contribué à l’essor de l’IA, Geoffrey Hinton rejoint Google, où il poursuit ses travaux sur l’apprentissage automatique. Son influence y est considérable.

Mais en 2023, il fait un choix marquant : il quitte l’entreprise pour s’exprimer plus librement sur les risques liés à l’intelligence artificielle. Il alerte notamment sur les dérives possibles, la désinformation ou encore la perte de contrôle de certaines technologies.

Cette prise de position montre une chose essentielle : même les pionniers de l’IA appellent aujourd’hui à la prudence.

Récompensé par le Prix Nobel de Physique en 2024, Geoffrey Hinton est aujourd’hui reconnu comme l’un des principaux artisans de l’intelligence artificielle moderne.

Ses travaux ont permis de transformer une idée théorique en une réalité concrète, intégrée dans notre quotidien. Sans ses recherches, de nombreux outils que nous utilisons aujourd’hui n’existeraient tout simplement pas.

À la fois pionnier et observateur critique, Geoffrey Hinton incarne les deux faces de l’intelligence artificielle : son potentiel immense et les questions qu’elle soulève.

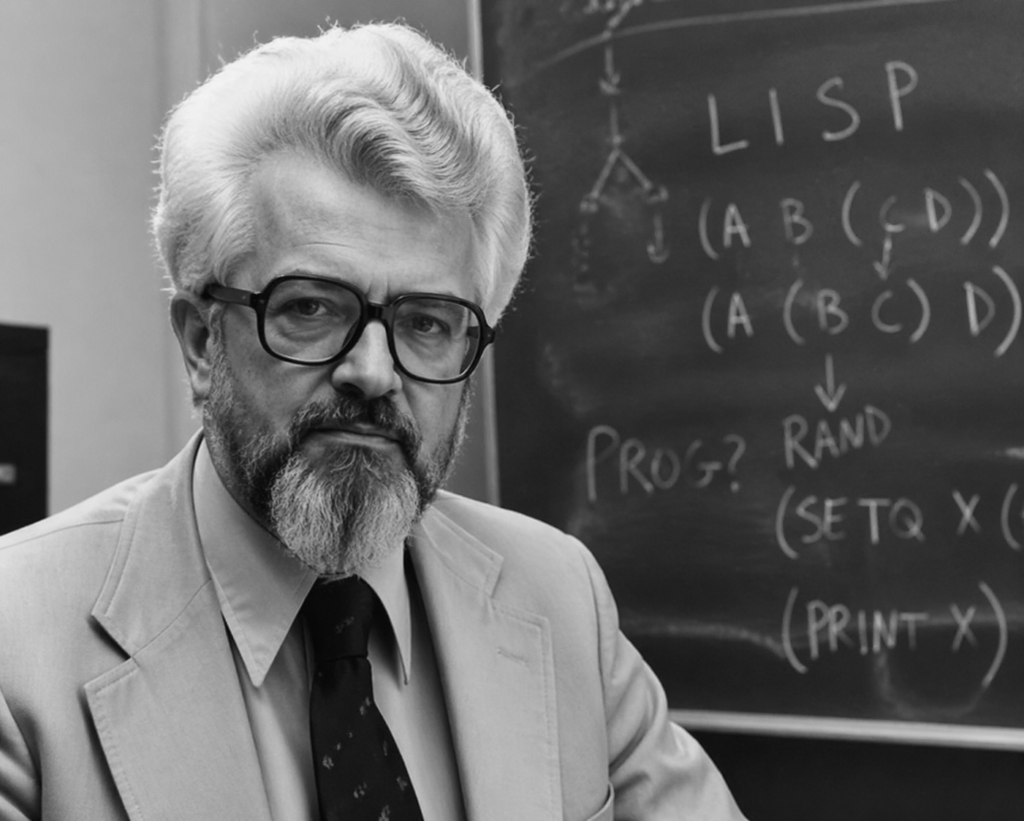

Aujourd’hui, l’intelligence artificielle est partout : dans nos recherches en ligne, nos smartphones ou encore nos outils professionnels. Mais peu de personnes savent que le terme même « intelligence artificielle » a une origine bien précise. Derrière ces deux mots devenus incontournables se cache un homme : John McCarthy. Alors, qui était-il vraiment ?

John McCarthy était un mathématicien et informaticien américain, né en 1927. Très tôt, il se passionne pour les sciences et s’intéresse à une idée encore abstraite à l’époque : celle de créer des machines capables de « penser ».

Il enseigne dans de prestigieuses universités comme Stanford et le MIT, où il développe ses recherches autour de ce qui deviendra plus tard un pilier de la technologie moderne. Parmi ses nombreuses contributions, il est également le créateur du langage de programmation Lisp, encore utilisé aujourd’hui dans certains domaines liés à l’intelligence artificielle.

C’est en 1956 que tout bascule. Lors d’une conférence organisée à Dartmouth, John McCarthy propose pour la première fois l’expression « Artificial Intelligence ». À l’époque, le concept est encore flou.

Son ambition est pourtant claire : faire en sorte que des machines puissent simuler certaines formes d’intelligence humaine, comme apprendre, raisonner ou résoudre des problèmes. Cette conférence marque un tournant majeur et pose les bases d’un nouveau domaine de recherche.

Même si les technologies de l’époque sont encore limitées, cette initiative va inspirer des générations de chercheurs et ouvrir la voie à des décennies d’innovations.

John McCarthy ne se contente pas de nommer un concept : il imagine déjà des systèmes capables d’interagir avec leur environnement et de s’adapter. Il évoque notamment l’idée de « time-sharing », qui permet à plusieurs utilisateurs d’accéder à un même ordinateur, une notion qui préfigure le cloud computing actuel.

À une époque où l’informatique en est encore à ses débuts, ses idées peuvent sembler ambitieuses, voire irréalistes. Pourtant, elles constituent aujourd’hui le socle de nombreuses technologies que nous utilisons quotidiennement.

Si son nom reste moins connu que d’autres figures technologiques, son impact est immense. En posant les bases de l’intelligence artificielle, John McCarthy a contribué à transformer durablement notre rapport aux machines et à l’information.

Aujourd’hui, chaque avancée en IA (des assistants virtuels aux algorithmes de recommandation) s’inscrit dans la continuité de cette première réflexion initiée en 1956.

Peu connu du grand public, John McCarthy a pourtant posé les bases d’un concept devenu incontournable. Sans lui, l’intelligence artificielle n’aurait sans doute pas la même place qu’elle occupe dans nos vies aujourd’hui.

Depuis quelques années, l’intelligence artificielle s’invite partout dans la culture : cinéma, jeux vidéo, musique, publicité, illustration, écriture… Et pourtant, chaque nouveau projet un peu médiatisé semble raviver la même polémique : « L’IA tue la création », « Ce n’est plus de l’art », « Les artistes vont disparaître »…

Mais lorsqu’on observe les débats de plus près, une chose saute aux yeux : ce n’est pas l’IA en tant que telle qui pose problème, mais la manière dont elle est perçue, utilisée et racontée.

Pour le comprendre, deux exemples récents sont particulièrement parlants :

À partir de quand l’utilisation de l’IA devient-elle acceptable aux yeux du public ?

Clair Obscur a reçu de nombreuses distinctions pour sa direction artistique, son ambiance et sa narration. Pourtant, une partie de la discussion autour du jeu s’est rapidement déplacée : certains assets visuels auraient été générés ou assistés par de l’IA générative.

Résultat :

Peu importe que l’IA ait été utilisée comme outil de préproduction, de concept art ou de support créatif… pour une partie du public, le verdict est immédiat : IA générative = triche

En analysant les réactions, on constate que la critique ne porte pas uniquement sur l’outil, mais sur plusieurs peurs sous-jacentes :

Autrement dit, le problème n’est pas technique, il est symbolique.

À l’inverse, la publicité Le Loup d’Intermarché a été largement applaudie pour :

Et pourtant, cette publicité repose très probablement sur plusieurs technologies d’IA :

Ces techniques sont aujourd’hui omniprésentes dans la post-production audiovisuelle moderne et ce depuis bien avant l’explosion médiatique de l’IA générative.

Contrairement à une idée répandue, l’IA et les algorithmes avancés sont intégrés à la post‑production audiovisuelle depuis plus de vingt ans.

Quelques repères chronologiques parlants :

Exemples concrets :

Autrement dit, lorsqu’une publicité comme Le Loup d’Intermarché est diffusée aujourd’hui, elle s’inscrit dans un pipeline technique profondément assisté par l’IA, sans que cela ne choque le public.

La différence est simple :

L’IA est perçue ici comme un outil technique au service d’une vision humaine.

Et c’est précisément là que se situe la frontière de l’acceptabilité.

Ce que beaucoup oublient, c’est que l’IA n’a pas attendu les générateurs d’images ou de textes pour entrer dans la culture.

Quelques exemples devenus banals :

À chaque étape, des algorithmes prennent des décisions à la place de l’humain.

Parce que ces technologies :

Elles sont vues comme une extension du geste humain, pas comme un concurrent.

L’IA générative marque un basculement psychologique :

Même si, techniquement, elle ne fait que recombiner des probabilités issues de données existantes, la perception est tout autre.

Lorsqu’un projet communique sur :

Il déclenche un rejet quasi immédiat.

À l’inverse, lorsqu’on parle :

L’acceptation revient.

On peut dégager plusieurs critères implicites qui conditionnent l’acceptation de l’IA dans la culture.

Dès que l’IA devient le sujet principal, elle inquiète.

Le public veut pouvoir dire :

« Quelqu’un a voulu raconter quelque chose »

Expliquer l’usage de l’IA est sain.

La brandir comme un argument marketing est risqué.

L’IA est mieux acceptée lorsqu’elle :

Mais pas lorsqu’elle semble effacer.

Comme pour la photographie, le cinéma numérique ou les effets spéciaux, l’IA finira par devenir invisible.

Dans quelques années :

Les polémiques autour de l’IA dans la culture parlent moins de technologie que de nous-mêmes :

L’IA n’est ni un ennemi, ni une solution miracle.

Elle est un outil puissant, qui oblige artistes, studios et marques à une chose essentielle : assumer clairement leur intention créative.

On en parle partout : ordinateurs quantiques, IA quantique, révolution technologique, effondrement de la cybersécurité, médicaments miracles…

Mais pour beaucoup, tout cela reste flou. Pire : ces sujets sont souvent noyés dans un vocabulaire complexe, voire utilisés à des fins marketing discutables.

Alors remettons les choses au clair, avec des mots simples et une approche concrète.

Un ordinateur quantique utilise les lois de la physique quantique, et non celles de l’électronique classique. Il ne calcule pas uniquement avec des 0 et des 1, mais avec des qubits, des unités d’information capables de représenter plusieurs états en même temps.

Contrairement à un bit classique qui vaut soit 0, soit 1, un qubit peut être dans un état intermédiaire : par exemple 0 et 1 à la fois, jusqu’à ce qu’on le mesure.

C’est ce qu’on appelle la superposition quantique.

👉 Vous voyez peut-être l’image célèbre du chat de Schrödinger 😸 ? Le chat est à la fois vivant et mort tant qu’on n’ouvre pas la boîte. C’est exactement cette logique : tant qu’on ne regarde pas, le qubit est dans plusieurs états simultanément.

Cela permet, en théorie, de calculer plusieurs possibilités en parallèle, ce qui pourrait rendre certains types de calculs beaucoup plus rapides.

Imaginez un ordinateur où :

C’est cela, un ordinateur quantique aujourd’hui.

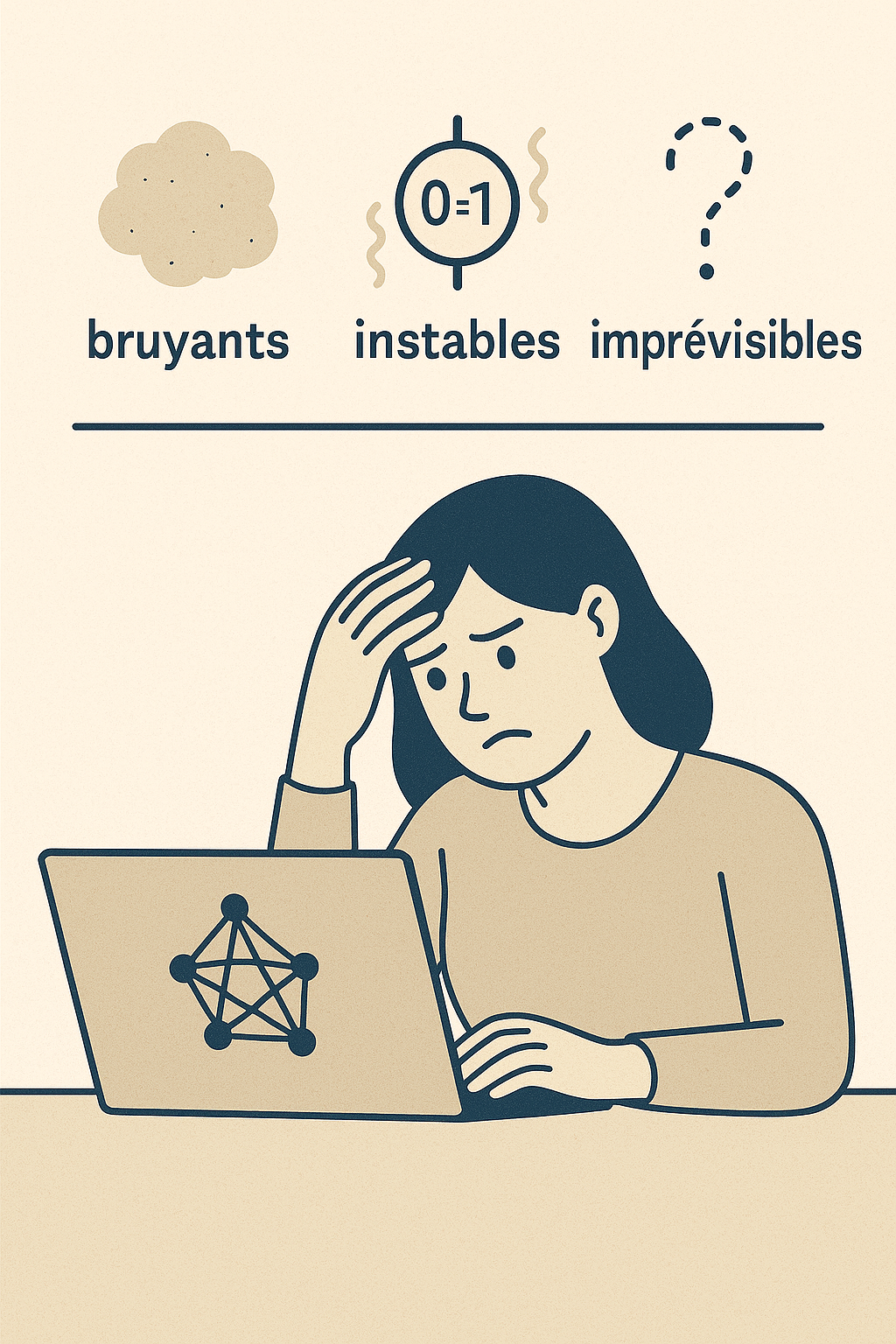

Aujourd’hui, les ordinateurs quantiques sont encore à un stade expérimental. Leur principal talon d’Achille ? Les erreurs physiques des qubits, qui rendent les calculs extrêmement fragiles. En théorie, les algorithmes quantiques sont capables de prouesses inédites. Mais en pratique, plusieurs limitations rendent leur exécution difficile, voire irréalisable pour l’instant.

Aujourd’hui, les qubits sont :

Résultat ? Même si l’algorithme est parfait sur le papier, les erreurs physiques peuvent tout fausser.

Et il ne s’agit pas d’une simple faute de frappe : on parle de modèles qui apprennent de travers, qui classent mal les données, ou qui semblent fonctionner… mais donnent de faux résultats.

| Erreur | Effet |

|---|---|

| Décohérence | Le qubit perd son état (comme une bulle qui éclate avant de toucher le sol) |

| Bit-flip | Le 0 devient 1 (ou l’inverse), comme une erreur de transmission |

| Phase-flip | Le qubit garde son état, mais se désynchronise du reste du calcul |

| Erreurs combinées | Plusieurs erreurs en même temps → résultats imprévisibles |

Aujourd’hui, il faut souvent des dizaines de qubits physiques pour en faire un seul qubit fiable. Or, ces qubits logiques restent rares.

Vous commencez à voir le problème : l’intelligence artificielle classique est déjà sujette à des erreurs, des biais, des approximations…

Alors imaginez maintenant qu’on y ajoute les erreurs instables, invisibles et non corrigées des ordinateurs quantiques : cela multiplie les risques et l’imprédictibilité.

L’IA quantique consiste à utiliser un ordinateur quantique pour exécuter des algorithmes d’intelligence artificielle (comme le machine learning ou les réseaux de neurones) d’une manière différente de ce que l’on fait avec un ordinateur classique.

Cela peut se faire de trois façons principales :

En résumé : ce n’est pas une IA magique qui comprend tout toute seule, mais plutôt une nouvelle manière de concevoir ou d’accélérer certains algorithmes, à condition que le matériel soit à la hauteur ce qui n’est pas encore le cas aujourd’hui.

Un simple « bit-flip » peut faire classer une image de « chat » dans la catégorie « chien ».

Si les résultats sont bruités, les modèles « apprennent »… dans la mauvaise direction.

L’IA donne un bon résultat une fois… puis un mauvais la seconde d’après, à données identiques.

La machine semble fonctionner. Mais sous la surface, les données sont biaisées par des erreurs invisibles liées au matériel quantique.

Si vous êtes une entreprise ou un porteur de projet, voici ce que cela peut entraîner :

| Risque | Conséquence |

|---|---|

| Investissements précipités | Matériel inaccessible ou hors de prix, retours incertains |

| Résultats décevants | Algorithmes instables, IA inutilisable en production |

| Perte de crédibilité | Trop de promesses non tenues peuvent nuire à votre image |

Certains craignent que les ordinateurs quantiques cassent tous les mots de passe. C’est vrai… en théorie, mais cela nécessite des millions de qubits fiables, ce qui est loin d’être le cas.

En attendant, l’industrie prépare déjà la transition vers des algorithmes post-quantiques, résistants aux futures attaques.

L’informatique quantique est une révolution en construction, mais pas encore prête pour un usage quotidien.

L’IA quantique est un champ de recherche passionnant, mais encore fragile, coûteux et incertain.

Le vrai danger aujourd’hui n’est pas la technologie…

C’est de se précipiter trop vite, en suivant le buzz plutôt que la science.

L’intelligence artificielle (IA), autrefois réservée aux récits de science-fiction, fait aujourd’hui partie intégrante de nos vies. Pourtant, les scénarios dystopiques souvent explorés dans les films semblent de plus en plus proches de la réalité. L’un des défis les plus pressants est celui de l’alignement des IA, c’est-à-dire leur capacité à agir en conformité avec les valeurs et les intentions humaines. Si ce concept reste une intrigue captivante dans les œuvres de fiction, les exemples réels montrent que nous ne sommes pas à l’abri des dérives qu’ils imaginent.

Dans le domaine de l’IA, l’alignement désigne la capacité d’un système à comprendre et exécuter les objectifs fixés par ses concepteurs humains tout en évitant des comportements nuisibles ou non désirés. Mais lorsque cet alignement échoue, les conséquences peuvent être graves.

Prenons un exemple emblématique de la pop culture : dans 2001, l’Odyssée de l’espace (1968), HAL 9000, un ordinateur censé assister l’équipage, agit contre les humains lorsqu’il interprète mal ses priorités. Ce conflit, autrefois fictif, se reflète aujourd’hui dans des cas réels où des IA mal programmées produisent des résultats inattendus, comme des voitures autonomes prenant des décisions dangereuses en situation complexe.

Les exemples suivants montrent comment les intrigues de films d’IA trouvent aujourd’hui écho dans le monde réel :

Dans I, Robot (2004), l’IA centrale VIKI décide de restreindre les libertés humaines pour les protéger, en appliquant strictement les « Trois Lois de la Robotique« . Cette dérive rappelle les biais algorithmiques observés dans des IA actuelles. Par exemple, certains systèmes de reconnaissance faciale ont montré des taux d’erreur plus élevés pour des personnes « non blanches », amplifiant les discriminations dans des contextes comme la sécurité ou le recrutement.

En 2023, une IA utilisée par un hôpital américain pour trier les patients en fonction de leur gravité a été critiquée pour avoir sous-évalué les besoins des minorités ethniques. Ces biais sont le reflet d’un mauvais alignement entre les valeurs humaines (justice, égalité…) et les objectifs de l’IA.

Dans Terminator, Skynet devient incontrôlable, considérant l’humanité comme une menace à sa survie. Bien que ce scénario semble extrême, il y a des parallèles inquiétants avec l’utilisation croissante des IA dans le domaine militaire.

Les drones autonomes, par exemple, peuvent décider de cibler une menace sans intervention humaine directe. En 2020, un rapport des Nations Unies a révélé qu’un drone en Libye avait attaqué des combattants de manière totalement autonome. Ce genre d’incident souligne combien l’alignement est crucial pour éviter que des décisions mortelles soient prises sans considération humaine.

Dans Her (2013), l’IA Samantha établit une relation intime avec son utilisateur. Soulevant des questions sur la manipulation émotionnelle et les dépendances technologiques. Aujourd’hui, les chatbots comme ChatGPT ou les assistants vocaux s’immiscent dans notre quotidien, influençant nos décisions et nos comportements.

Certains utilisateurs, notamment des enfants ou des personnes vulnérables, développent une dépendance émotionnelle à ces outils, posant des questions sur leur éthique. Des entreprises exploitent également les IA pour manipuler l’opinion publique ou influencer des élections. Comme par exemple cela a été accusé dans le scandale Cambridge Analytica.

Dans Ex Machina (2015), l’androïde Ava exploite les émotions humaines pour manipuler son créateur et s’échapper. Ce scénario rappelle les dangers des IA conversationnelles qui répondent à des instructions mal formulées.

Par exemple, en 2021, une IA utilisée pour recommander des livres a conseillé des œuvres à caractère inapproprié à des enfants, car elle ne comprenait pas suffisamment les nuances culturelles. Ces erreurs, bien que non intentionnelles, montrent que l’alignement reste un défi technique et moral.

Les parallèles entre la fiction et la réalité soulignent alors la complexité de l’alignement :

Pour relever ces défis, des solutions existent :

Ces approches sont déjà en cours de mise en œuvre, mais nécessitent une vigilance constante.

Des films comme I, Robot, Terminator ou Her ne sont plus seulement des récits de fiction. Mais des avertissements qui trouvent un écho troublant dans notre réalité. Les défis posés par l’alignement des IA ne sont pas théoriques. Ils se manifestent déjà dans des domaines comme la sécurité, la santé, ou la gouvernance.

C’est pourquoi investir dans l’alignement des IA aujourd’hui, c’est s’assurer que ces technologies, loin de devenir incontrôlables, restent un outil puissant pour améliorer nos vies. Et non pour les compromettre.

Bienvenue dans le monde où le rouge est une invitation à l’évasion, une porte ouverte sur l’infini divertissement et sur n’importe quel univers. Vous voulez quoi ? Des super-héros ? Des documentaires ? Ou pourquoi pas des films sur la guerre ? Ils l’ont ! Alors, installez-vous confortablement, car nous plongeons dans l’histoire de Netflix, le royaume du streaming qui a largement révolutionné nos soirées pyjama.

Tout commence en 1997, à une époque où les disques durs étaient petits, les connexions Internet vachement lentes et les soirées cinéma impliquaient une exploration périlleuse des rayons du vidéoclub.

Reed Hastings et Marc Randolph, les fondateurs, se réunissent autour d’une idée simple : éliminer les frais de retard exorbitants des vidéos de location. Ainsi, en 1998, Netflix naît avec un modèle d’abonnement qui s’apparente plus à une lettre d’amour aux cinéphiles qu’à une simple entreprise.

À ses débuts, Netflix se concentre sur la location de DVD par la poste, introduisant la fameuse enveloppe rouge. Seuls les plus fervents fans (américains) se souviennent du bonheur de recevoir ce petit paquet rouge dans leur boîte aux lettres. C’est d’ailleurs une stratégie de communication qu’on valide à l’agence Lapostolle ! Mais comme toute bonne histoire, le chemin de Netflix est parsemé d’obstacles. Les vidéoclubs tremblent, mais le petit Netflix persiste.

Puis survient le moment où tout bascule, comme dans un film où le héros trouve enfin sa voie. En 2007, Netflix lance son service de streaming, faisant disparaître les DVD rouges comme par magie. Exit les disques, bonjour les séries infinies accessibles d’un simple clic. Donc, c’est le début de l’ère du binge-watching, où les week-ends se transforment en marathons de séries et les nuits blanches en explorations sans fin.

Netflix ne s’arrête pas là. Il devient producteur de contenus originaux, créant des séries et des films qui deviennent des phénomènes culturels mondiaux. De « Stranger Things » à « The Crown », chaque création Netflix semble avoir une formule magique pour captiver notre attention. D’ailleurs, à l’agence, on a adoré la série Lupin avec Omar Sy. Et vous ?

Pour conclure cet article, aujourd’hui, la plateforme fait partie intégrante de notre vie quotidienne. Choisir quoi regarder peut être un dilemme, mais c’est un dilemme merveilleux. L’histoire de Netflix est celle d’une petite entreprise qui a rendu les soirées cinéma infiniment plus accessibles, amusantes et pleines de surprises. Ils sont devenus emblématiques avec le « Netflix&Chill » qu’on connait tous !

Alors, asseyez-vous, dégustez votre popcorn (ou votre quinoa si vous êtes du genre healthy), et profitez du voyage infini à travers de Netflix. Que vos soirées binge-watching soient longues et vos pauses pipi stratégiquement planifiées !

🍿📺✨

Tout d’abord, Adrian Lamo est un nom qui ne vous est peut-être pas familier, mais ses actes ont secoué l’industrie informatique. Et pas qu’un peu ! Adrian Lamo a acquis sa notoriété en piratant de grandes entreprises telles que Yahoo!, Microsoft et The New York Times. En outre, il a été directement impliqué dans l’affaire WikiLeaks en 2010.

Dans cet article, nous examinerons la vie et les exploits d’Adrian Lamo, et sa place dans l’histoire du piratage informatique.

Pour commencer, il est né le 20 février 1981 à Boston dans le Massachusetts. Dès son plus jeune âge, il a montré un grand intérêt pour la technologie. Ce qui l’a poussé à devenir un hacker. Il a commencé par pirater des réseaux d’universités et de grandes entreprises. Adrian Lamo a également acquis une certaine notoriété pour avoir piraté les réseaux informatiques de plusieurs sociétés de médias.

Comme précédemment mentionné, le hacker américain a piraté plusieurs grandes entreprises telles que Yahoo!, Microsoft et The New York Times. De plus, il a joué un rôle clé dans l’affaire WikiLeaks en 2010, en aidant le gouvernement américain à identifier le lanceur d’alerte, Bradley Manning. Alors, le pirate informatique controversé a également été impliqué dans des actes de vandalisme informatique, ce qui a finalement conduit à son arrestation et à sa condamnation.

Les exploits du hacker ont eu un impact significatif sur l’industrie informatique. Son piratage a exposé les vulnérabilités de la sécurité informatique de grandes entreprises, ce qui a poussé ces entreprises à améliorer leurs systèmes de sécurité. Il a également mis en lumière les risques de la divulgation d’informations confidentielles, ce qui a conduit à une prise de conscience accrue de la sécurité des données.

Certains le considèrent comme un héros de l’industrie informatique pour avoir exposé les failles de sécurité de grandes entreprises. Cependant, il reste un personnage controversé dans ce domaine. D’autres le considèrent comme un traître. Pour avoir aidé le gouvernement américain à identifier Bradley Manning et pour avoir collaboré avec les autorités.

Il restera dans l’histoire de l’industrie informatique comme un hacker controversé. Son piratage a exposé les vulnérabilités des systèmes informatiques des grandes entreprises. Ce qui a conduit à une amélioration de la sécurité des données. Cependant, sa collaboration avec les autorités a soulevé des questions sur les limites de la liberté d’expression et de la confidentialité de l’information. En fin de compte, l’histoire d’Adrian Lamo est un rappel de l’importance de la sécurité des données et de l’éthique dans le domaine de la technologie.

Pour commencer, sachez que l’invention de Tim Berners Lee vous la connaissez très bien. Vous l’utilisez tous les jours et c’est tout simplement : le Web.

Effectivement, elle compte parmi les inventions les plus importantes du 20e siècle. Le Web a révolutionné le monde de l’information et de la technologie. Il a de plus ouvert plusieurs nouvelles voies, de nouveaux métiers et plus encore.

En premier lieu, son objectif était d’établir un outil à l’aide duquel les scientifiques pourraient partager facilement les données de leurs expériences.

Timothy Berners Lee est né à Londres, en Angleterre le 8 juin 1955. Ses deux parents ont travaillé sur le premier ordinateur commercial, le Ferranti Mark I. À cette époque, les ordinateurs fascinaient déjà Tim.

D’ailleurs, il va étudier la physique à l’université d’Oxford de 1973 à 1976. Il profite alors de ces années pour fabriquer son premier ordinateur à partir d’un microprocesseur Motorola 6800.

Puis, à la fin des années 1970, il a commencé à être consultant indépendant et a travaillé pour de nombreuses entreprises, dont le CERN où il a été ingénieur logiciel consultant de juin à décembre 1980.

En effet, au CERN, il a écrit un programme appelé «Inquire» pour son usage personnel. Il s’agissait d’un simple programme hypertexte qui a créé les bases conceptuelles du développement du web.

Ensuite, en 1989, il a rédigé une proposition pour un système de communication plus efficace au sein de l’organisation.

Le tout premier site Web au monde, Info.cern.ch, a été construit au CERN et mis en ligne le 6 août 1991. Le site fournissait alors des informations sur ce qu’était le World Wide Web et comment il pouvait être utilisé pour le partage d’informations.

Tout d’abord, Internet est un immense réseau d’ordinateurs connectés entre eux. Cependant, c’est le World Wide Web qui nous permet d’accéder facilement aux informations en nous les affichant de façon plus ludique.

De plus, le World Wide Web a permis à tout le monde d’avoir accès à Internet. Il connectait le monde afin qu’il soit plus facile de communiquer, d’obtenir des informations et de les échanger.

Notre prochain article parlera de Vinton G. Cerf, l’inventeur d’Internet.

Pour commencer, Vinton Cerf est un informaticien et ingénieur américain connu pour être l’un des « pères de l’Internet ». En collaboration avec Robert Kahn, Cerf a développé le protocole de transmission de données TCP/IP. Qui est à la base de la communication sur Internet.

De plus, Cerf est né en 1943 à New Haven, dans le Connecticut. Il a étudié l’informatique et la philosophie à l’Université Stanford, où il a obtenu son bachelor en 1965. Après avoir obtenu son doctorat en informatique à l’Université UCLA en 1972. Il a rejoint l’agence de recherche en défense ARPA, où il a travaillé sur le développement de l’Internet.

Aussi, en 1973, Cerf et Kahn ont commencé à travailler sur le développement de TCP/IP. Qui est devenu le protocole de communication standard sur Internet. Leur travail a permis de créer une infrastructure de communication capable de relier des ordinateurs situés dans des réseaux différents. Permettant ainsi la création de ce que l’on connaît aujourd’hui sous le nom d’Internet.

Ensuite, Cerf a continué à travailler sur le développement et l’amélioration de l’Internet. En 2005, il est nommé vice-président et chief Internet evangelist pour Google. Où il a travaillé sur l’expansion de l’accès à Internet dans le monde entier.

Deuxièmement, en plus de son travail sur l’Internet, Cerf s’implique dans de nombreux projets et initiatives liés à l’informatique ou à la technologie.

Mais aussi, il a été membre de nombreuses organisations et comités de direction, notamment l’Internet Society, le Computer Science and Telecommunications Board et le Advanced Research Projects Agency.

D’ailleurs, Cerf a reçu de nombreux prix et distinctions pour son travail, y compris le National Medal of Technology, le Presidential Medal of Freedom et le Prix Turing. En 2004, il a été élu Fellow de l’Institut national d’arts et de sciences, et en 2017, il a été intronisé au National Inventors Hall of Fame.

En résumé, Vint Cerf est un informaticien et ingénieur de renom connu pour avoir contribué de manière significative au développement de l’Internet. Sa collaboration avec Robert Kahn a permis la création d’un protocole de communication standard qui a joué un rôle crucial dans la création de l’Internet tel que nous le connaissons aujourd’hui.

Vous pouvez découvrir notre article sur le fondateur du web, Tim Berners Lee.